AI 推動光互連技術應用,實現 GPU 可擴展通信

AI 通常被定義為算力故事:更大的模型、更快的 GPU、布滿加速器的數據中心。但隨著系統持續擴容,真正的限制并非算力,而是數百、數千乃至數百萬處理器間的通信。

圖一:人工智能數據中心規模擴展集群規模的演變。

現代 AI 的核心是矩陣乘法,大型神經網絡可將運算分配至多個處理單元,并行計算成為提升性能的首選方案。但模型規模超過約 100 億參數后,小型本地計算域無法支撐擴容,工作負載需分配至多個圖形處理器(GPU),覆蓋板卡、服務器、機架,乃至跨建筑區域級光纖網絡。

實際應用中,GPU 需協同如同一臺超大處理器,需在集群內持續交換梯度、參數、激活值與同步流量。該規模下,網絡性能與算力深度綁定 —— 數據傳輸速度不足,加速器將處于等待狀態。行業面臨 “銅墻瓶頸”,在層級延遲敏感環節形成阻礙,制約擴容集群內 GPU 互聯所需的高速鏈路。

需要明確的是,銅互連并未過時。短距離場景中,電互連成熟、低成本、實用性強。但單通道 200 吉比特每秒信令場景下,權衡劣勢凸顯:200 吉比特每秒單通道下,直連銅互連傳輸距離縮短至 1 至 2 米,延長距離需中繼器,增加功耗與成本。隨著 AI 擴容集群規模更大、密度更高,銅互連已無法滿足需求,行業轉向光通信,實現更高帶寬、更快速度、更高基數與更低功耗。

光互連向內滲透

光通信已在橫向擴展網絡(機架間、排間鏈路)成熟應用,當前行業核心議題是未來 AI 系統的光電轉換邊界。例如,開放計算項目的短距離光互連計劃,通過定義光互連需求與指標,提升處理器間、處理器 - 內存帶寬。

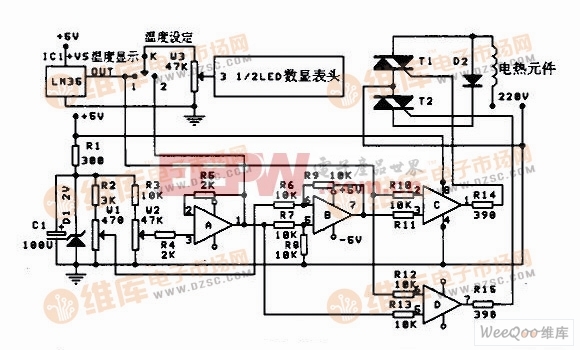

圖 2. 人工智能網絡中的互連方式。目前,服務器內的 GPU 之間使用銅質互連(2a),而用于服務器之間互連的則是可插拔的光收發器(2b)。未來,帶有外部光源的 CPO(光互連處理器)有望用于服務器內部的規模擴展網絡(2c)以及服務器之間的規模擴展網絡(2d)。

傳統插拔式光學設計中,電信號需穿過電路板到達收發器后轉換為光信號。在最高數據速率下,這些電氣路徑的損耗、均衡、功耗與布局復雜度問題愈發突出。共封裝光學(CPO)將光引擎直接部署在芯片封裝旁,縮短高速銅跡線長度,實現更高帶寬密度與更低每比特能耗;傳統收發器被拆分為芯片旁光引擎、外部激光源與光纖互連三部分。

行業逐步轉向外部激光架構,因激光對溫度敏感,與封裝最熱區域分離更易管控。英偉達與博通均在 2025 年宣布共封裝光學重大技術突破,預計 2028 至 2030 年實現量產。

共封裝光學:優勢顯著,挑戰重重

共封裝光學本質是異質集成難題,需將不同材料體系、器件類型、制造工藝整合至緊湊高性能封裝中。行業正探索多種激光方案、調制器方案,以及光引擎、光源、主機專用集成電路(ASIC)的功能劃分方式。每種設計選擇都會影響封裝尺寸、插入損耗、熱敏感性、可制造性、成本與長期可靠性。核心挑戰不僅是打造高速光鏈路,更是保障鏈路可通過封裝、認證、量產與現場部署。行業正積極應對這些挑戰,2026 年光纖通信博覽會(OFC)前后,涌現出多項多源協議,例如光計算互連多源協議、開放共封裝多源協議產業聯盟。

熱管理是最大難題之一。GPU 與交換專用集成電路已處于極高要求的熱環境中,將光學器件靠近這些器件,直接引發激光壽命、調制器性能、封裝界面與系統穩定性問題。外部激光架構備受青睞的原因之一,是可將溫度最敏感的元件遠離最熱區域,但該選擇也帶來封裝、系統權衡問題,例如對準、布線、可維護性與整體系統復雜度。

制造環節進一步增加難度。光引擎輸出光纖數量越多,AI 集群并行性越高、網絡拓撲越扁平。但實際應用中,光纖附著是光學組裝中最難、成本最高的環節,尤其是需要主動對準的場景。每增加一根光纖,都會影響良率與成本。這意味著最優方案并非物理原理最完美的方案,而是能最佳平衡帶寬、組裝復雜度、熱管理與可制造性的方案。

綜上,AI 首先讓并行計算成為必需,隨后讓分布式計算不可避免,如今正推動互連架構重構。光鏈路已在長距離數據中心網絡普及,下一步將深入計算封裝內部 —— 銅互連越來越難以滿足帶寬、傳輸距離與能效的綜合需求。共封裝光學成為解決該問題的主流方案,并非因其簡單,而是替代方案的擴容難度越來越大。

評論