MUSA獲得SGLang主線支持!5月10日北京,AI Meetup等你來

5月10日,北京,一場硬核技術沙龍即將開啟。

SGLang、TileLang、Triton、Mooncake等技術大牛,將齊聚一堂,深度探討「SGLang × MUSA」落地實踐,分享推理引擎、算子編譯和工程優化的硬核干貨。

無論你是框架開發者、算子工程師,還是關注國產GPU生態的AI從業者,將有機會與技術專家進行深度交流,獲取行業前沿洞察。(掃描文末二維碼報名或預約直播)

這場Meetup的契機,源于一個重磅消息:摩爾線程MUSA后端,正式加入全球領先的開源推理框架SGLang的官方支持體系,相關代碼也已成功合入SGLang主線。

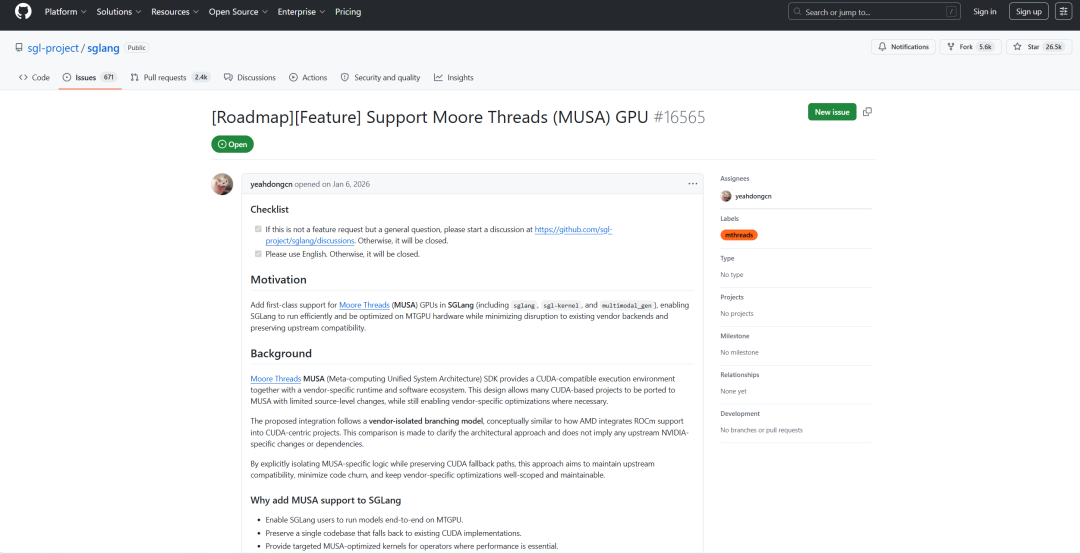

圖注:SGLang GitHub官方倉庫展示的 Moore Threads(MUSA)GPU 支持開發規劃與路線圖

代碼合入SGLang主線,標志著摩爾線程全功能GPU獲得SGLang“原生支持”(First-Class Support),成為官方后端矩陣一員。

現在,無論是用SGLang框架本體sglang、高性能算子庫sgl-kernel,還是多模態生成組件multimodal_gen,開發者均可原生調用摩爾線程GPU,享受極致性能優化。

▼SGLang 開源地址:

https://github.com/sgl-project/sglang

▼SGLang × MUSA Roadmap 地址:

https://github.com/sgl-project/sglang/issues/16565

打破壁壘:國產GPU融入全球開源生態

SGLang是業界領先的大語言模型推理與服務框架,憑借卓越的吞吐性能和靈活的編程接口,受到開發者廣泛關注。

此次,摩爾線程貢獻的MUSA后端,原生支持MUSA架構的算子加速與顯存管理,同時開源MATE算子庫,為SGLang在摩爾線程GPU上的高效運行提供了堅實的核心性能支撐。開發者在AI訓推一體智算卡MTT S5000上運行DeepSeek、Qwen等主流模型,可實現“開箱即用”的推理加速。

摩爾線程進入SGLang官方后端矩陣,不僅意味著國產GPU在生態適配上擁有更充分、更直接的兼容路徑,也為中文AI社區提供了一條基于國產硬件的高性能推理路徑。

開發者只需克隆 SGLang 官方倉庫,并執行以下命令,即可獲得同時支持大語言模型(LLM)與多模態模型(文生圖/文生視頻等)的運行能力:

安裝 SGLang kernel(MUSA支持)

python setup_musa.py install

安裝SGLang及其完整MUSA依賴環境

pip install "python[all_musa]"

未來,隨著SGLang官方發布針對MUSA架構優化的正式sglang-kernel build,還可以通過以下命令安裝專為摩爾線程硬件優化的kernel版本:

pip install sglang-kernel --index-url https://docs.sglang.io/whl/musa<<version>>

MUSA開源技術沙龍:

SGLang × MUSA Meetup

為慶祝這一重要合作,摩爾線程聯合SGLang社區將于5月10日(周日)下午在北京舉辦技術Meetup,采用「線下活動 + 線上直播」雙通道形式。

▼ 議題一:框架適配與架構演進

SGLang核心貢獻者Xiaoyu Zhang(BBuf)與摩爾線程核心貢獻者,將分享SGLang Roadmap、kernel優化、Vibe Coding應用、MUSA移植落地等。

▼ 議題二:算子編譯與性能優化

Triton、TileLang項目技術大牛,揭秘算子工程,分享高性能算子生成、MUSA專項優化、MATE技術協同。

▼ 議題三:系統整合與生態共建

Mooncake等明星項目專家將探討訓推一體系統與開源社區協同,共建 AI 新生態。

誠摯邀請開發者朋友們

掃碼報名線下參會,或預約線上直播,與技術大牛面對面,共探 AI 無限可能。

評論