協處理器新時代:異構計算架構如何跟上AI浪潮

核心要點

沒有任何一種處理器能高效執行所有任務,必須采用多處理器協同架構。

最大化效率的關鍵是最小化數據移動。

架構師必須在滿足當前負載效率的同時,預留足夠靈活性以適配未來需求。

得益于 AI 帶來的負載變革,新一代處理器架構正快速演進,但沒有任何一款處理器能 “包打天下”。協同在紙面上很簡單,實際實現卻困難重重。

歷史上從未出現過能通吃所有場景的處理器架構。過去 50 年,CPU 一直是主力計算單元,但即便在 PC 早期,人們就已意識到部分負載需要更專用的處理能力 ——8086 就搭配了 8087 浮點協處理器。

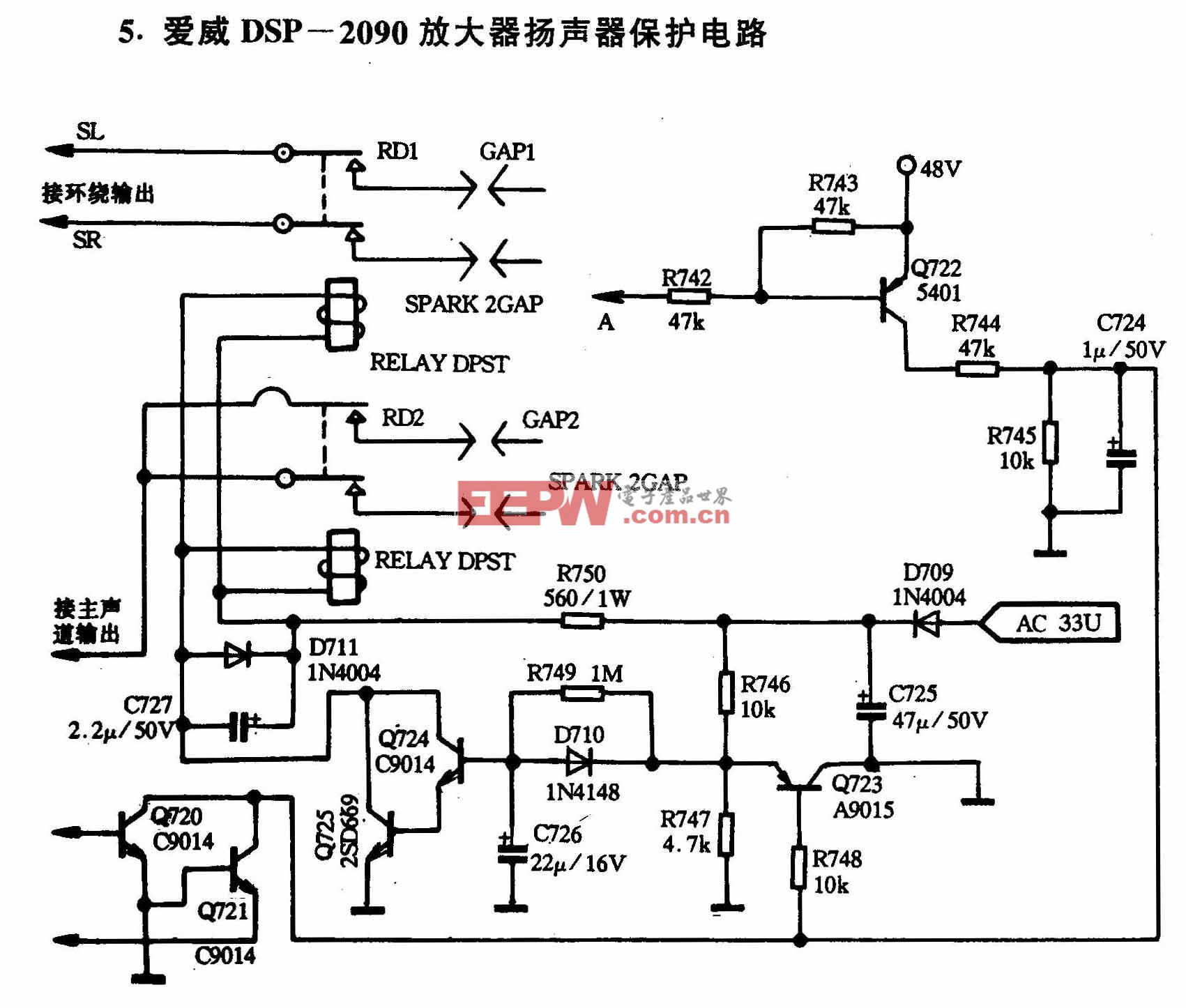

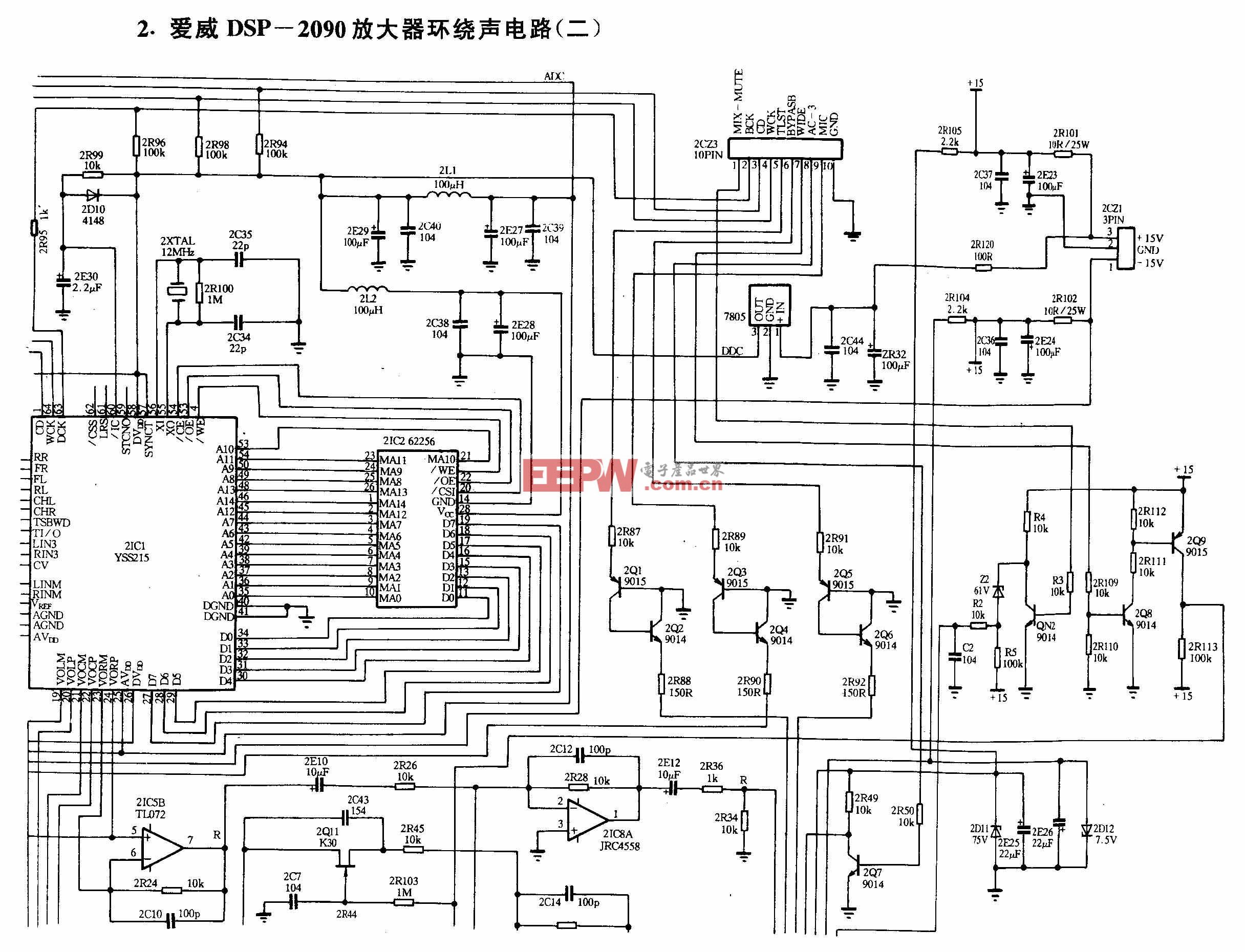

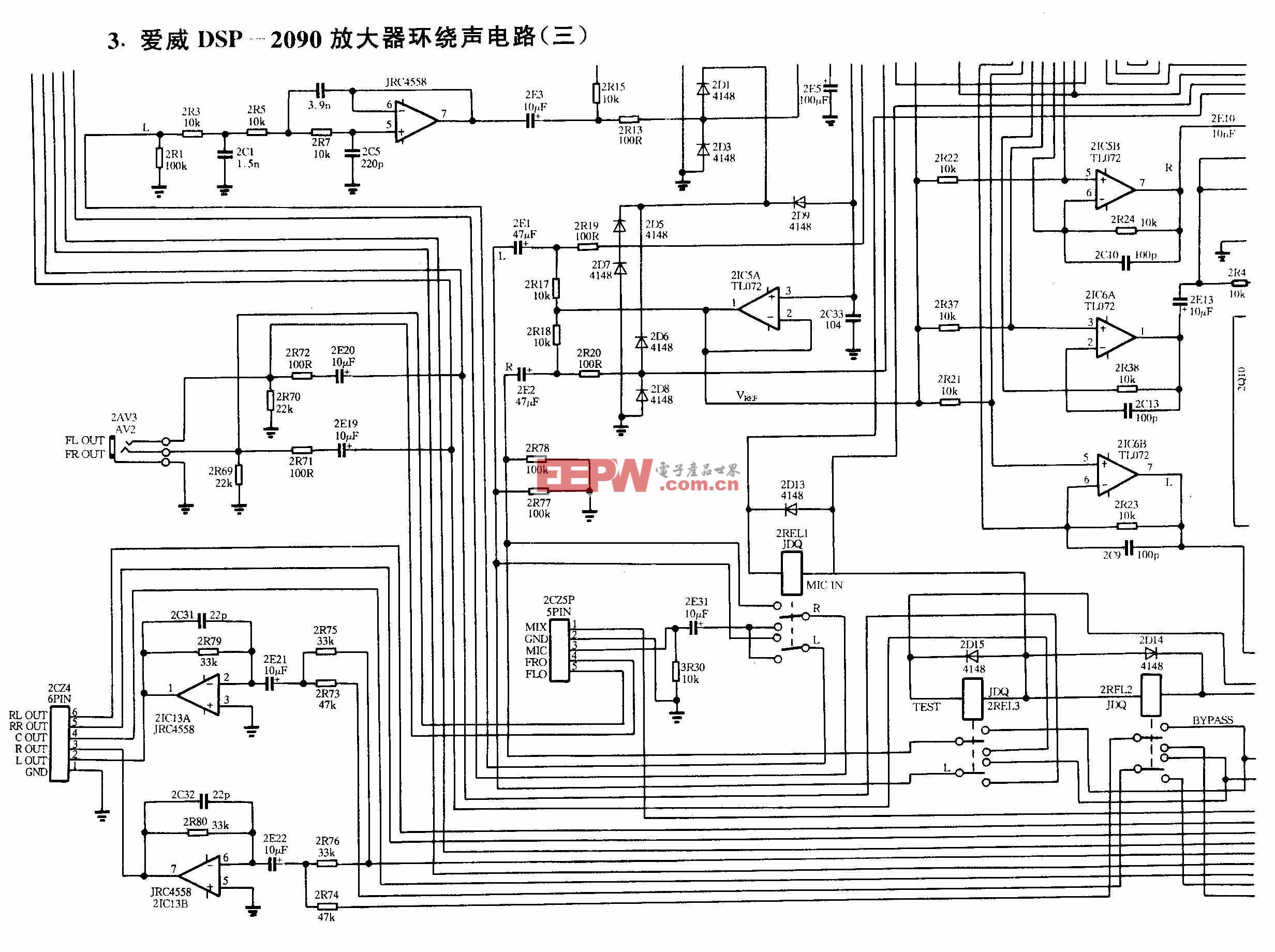

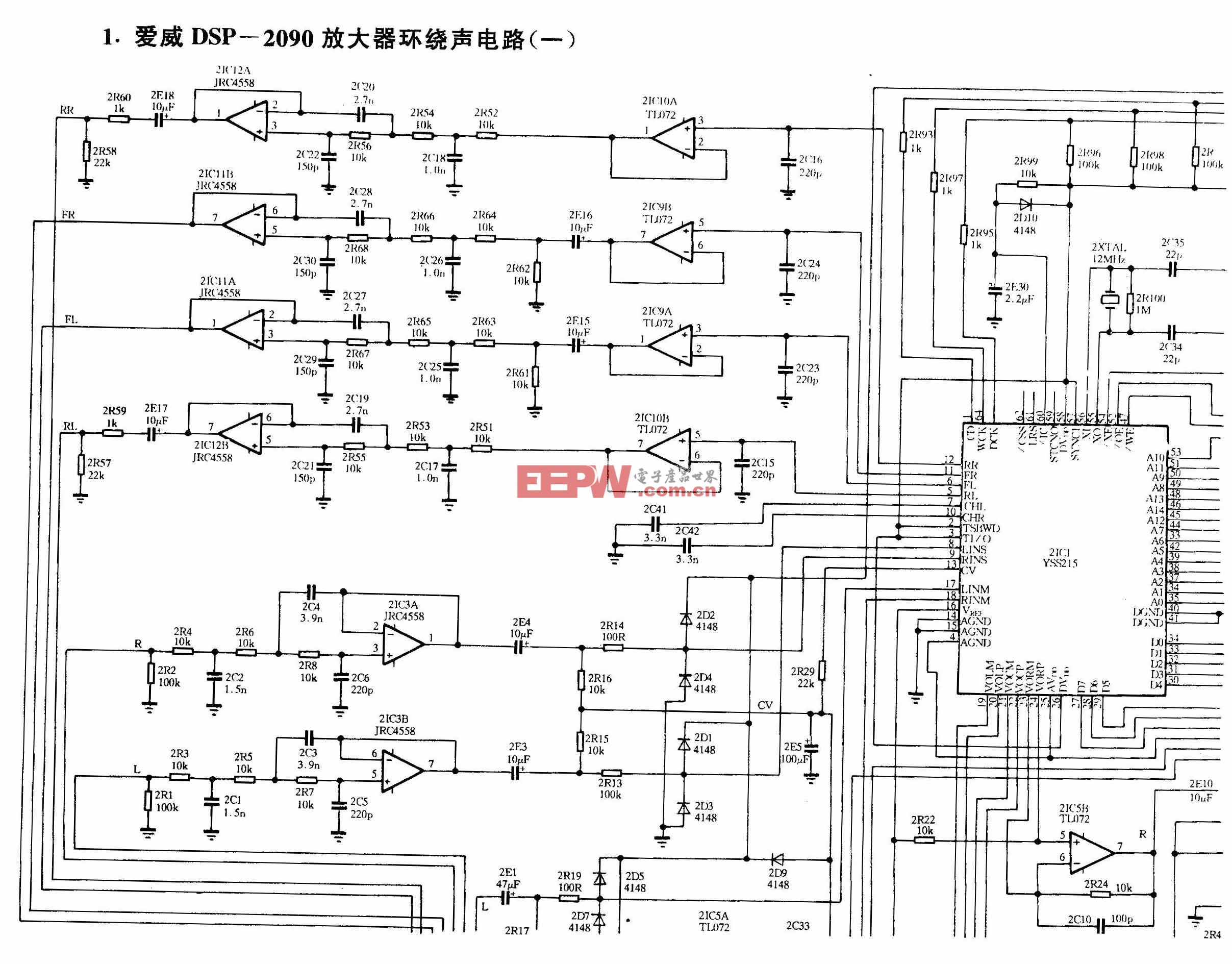

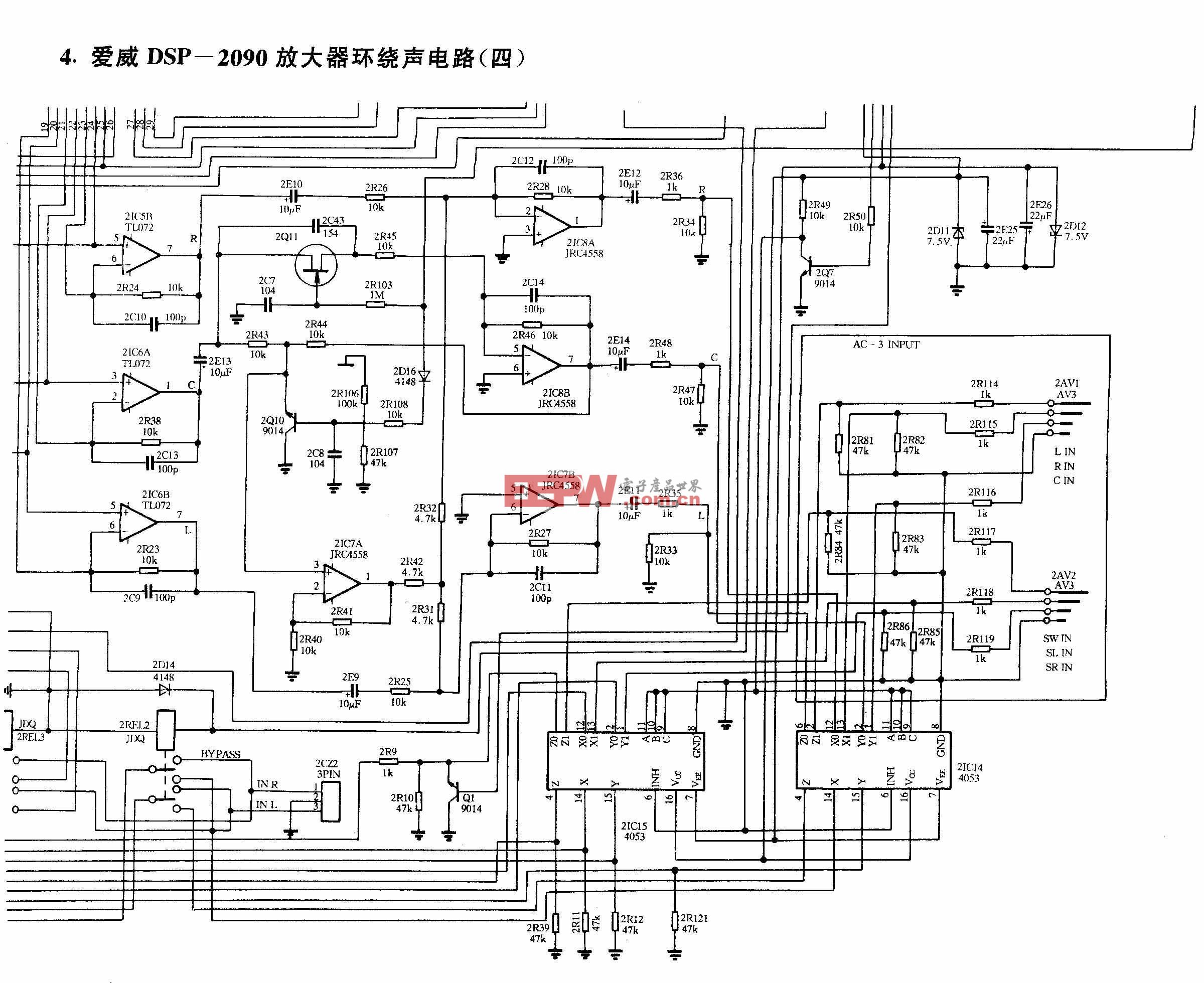

音頻處理與手機的普及,讓數字信號處理器(DSP)成為必備第二處理器。這類架構意識到數據傳輸是性能瓶頸,將數據與指令流分離,并加入專用乘累加單元,以快速完成傅里葉變換。后續又逐步擴展支持編解碼、壓縮、調制、解調與糾錯等功能。

CAD 等應用對圖形處理速度提出更高要求,推動了商用游戲市場崛起與 GPU 架構快速迭代。正是這些處理器讓 AI 從規則驅動走向模型驅動,一路發展至今。

遷移到新架構并非易事。Quadric 首席營銷官 Steve Roddy 表示:“SoC 三十年演進呈現出一致規律:功耗 - 性能驅動新處理器品類誕生,但可編程性決定其能否成功。如果 CPU 能在功耗與性能范圍內跑完負載,就會一直用 CPU;只有當 CPU 效率不足時,架構師才會引入專用化設計。”

AI 的快速迭代同樣引發硬件架構革新,其演進速度甚至超過硬件設計、驗證、量產與部署的速度。ChipAgents 首席執行官 William Wang 指出:“協處理器的核心問題歸根結底是負載。隨著 AI 系統演進,負載正從簡短的內核型推理任務,轉向長時運行的智能體任務,涉及推理循環、工具調用、內存訪問與多組件交互。在這種場景下,挑戰不再是打造更快的計算模塊,而是在通用可編程性與 ASIC 級效率之間取得平衡。”

許多公司曾嘗試推出新處理器架構,紙面參數亮眼卻最終失敗。南安普頓大學 AI 與 EDA 研究員 Simon Davidmann 認為:“成功的協處理器,通常能同時最小化數據移動、軟件摩擦與驗證風險。在 AI 領域,最好的協處理器不是峰值 TOPS 最高的那個,而是數據移動浪費能量最少的那個。”

架構演進

在包含多個異構處理單元的協同環境中,通常由一個處理器擔任協調角色。新思科技(Synopsys)首席產品經理 Gordon Cooper 解釋:“無論何種場景,都有一個高層主機,通常是 CPU,其他所有單元都可視為協處理器。我們擁有神經網絡處理器(NPU)IP,它雖是完整處理器,但仍聽命于主機。面對大語言模型時,主機雖可承擔部分工作,但會將絕大多數任務卸載給 NPU—— 在大語言模型或視覺語言模型中,由 NPU 做矩陣運算效率高得多。而這一切都始于主處理器的控制。我們的 NPU 內部包含多個標量處理器、向量處理器與專用數學引擎,是一個典型的異構算力集合體。”

NPU 已快速迭代。楷登電子(Cadence)AI IP 與軟件產品營銷總監 Amol Borkar 表示:“NPU 用于運行 AI 模型,但過去通常是高度專用的固定功能硬件。如今 AI 模型愈發復雜,不再只有 MAC 運算,還需要硬件輔助非 MAC 操作與激活函數。這讓 NPU 具備一定靈活性。但我們發現,只要出現新層、新算子、新版 Llama 或 Claude 模型,就會面臨挑戰:如果額外硬件無法支持這些新算子,網絡可能無法運行。”

Arm 則通過全新 AGI CPU 走出截然不同的路線,大幅提升 CPU 每瓦性能。Arm 首席執行官 Rene Haas 稱:“隨著智能體 AI 主流化,相關工作負載高度依賴 CPU 性能。數據中心正面臨瓶頸:昂貴的加速器生成 Token 后,需要通過云端回傳,形成巨大瓶頸。這意味著需要越來越多的 CPU。”

這也讓處理器與協處理器的邊界愈發模糊。Arteris 產品管理與營銷副總裁 Andy Nightingale 指出:“如今協處理器架構覆蓋緊耦合單元、松耦合加速器、基于互連的分布式系統。緊耦合設計延遲低、內存共享、編程簡單,適合小規模或低延遲敏感場景,但因資源競爭與一致性開銷難以擴展;松耦合方案多采用小芯片實現,支持模塊化擴展與訓練、推理、網絡等功能專用化,但延遲更高,軟硬件協同復雜;基于互連的架構兼顧可擴展性與動態資源共享,但對互連要求極高,系統級復雜度顯著提升。”

RISC-V 生態正嘗試開創全新可能:實現處理器與協處理器的融合。Breker Verification Systems 首席執行官 Dave Kelf 表示:“對于加速器與高度專用處理器架構,RISC-V 指令集具備獨特優勢。我們看到基于 RISC-V 的加速器開始出現,處理單元直接集成在加速器內部,消除了獨立單元間的控制與數據傳輸開銷。在低功耗場景中,僅保留必需處理器單元與加速器的組合可顯著省電,尤其適用于 AI 設備,標準化軟件棧可直接部署在加速器上。這是 RISC-V 開啟的全新范式,也可能是開放指令集的未來。”

這種思路既可用于為 CPU 增加功能,也可用于為 NPU 加入通用處理能力。楷登電子 AI IP 產品營銷總監 Jason Lawley 稱:“處理器間切換存在時間與距離開銷。我們需要權衡為向量與標量處理分配多少面積,同時清楚無法完全替代 CPU。因此可以看到小型 RISC-V 核更靠近 MAC 陣列,它們無法完成大型 CPU 的所有任務,軟件開發者需要合理劃分負載以實現效率最大化。”

放眼純電子領域之外,還存在更多可能。是德科技(Keysight)高速數字產品組合經理 Jan van Hese 提到:“還有光子 AI 加速器等新型處理器,優勢顯著,雖設計難度大,但一旦實現,速度極快且功耗極低。”

綁定各類處理器的架構也在持續變化。楷登電子的 Lawley 表示:“談及協處理器,計算位置始終在動態變化,并影響數據移動與存儲方式。大量計算目前由 GPU 與 NPU 完成,但隨著 AI 成熟,尤其是智能體出現,CPU 工作量開始回升。過去是一個 CPU 加大型 MAC 陣列,如今變為每一定數量 MAC 就需要搭配一個 CPU。站在 NPU 角度,NPU 是世界中心,其他都是協處理器;站在 CPU 角度則相反。總會有專用功能無法被單一處理器覆蓋,這就是協處理器存在的意義。”

歷史或許預示著未來的收斂方向。Quadric 的 Roddy 指出:“專用處理器通過將原生數據類型與計算原語適配負載提升效率,但僅靠專用化遠遠不夠。緊耦合的‘輔助’加速器無法真正解放 CPU,分區執行會增加互連流量、延遲與功耗。系統級效率取決于獨立性。早期圖形引擎是附加式加速器,只有當全可編程 GPU 出現并與 CPU 解耦后,才實現真正規模化,DSP 領域也是如此。AI 正跨越同樣的界限:從固定功能加速器走向全可編程、獨立的 AI 處理器。除功耗與性能提升外,獨立性還能簡化集成、驗證、建模與小芯片擴展。”

各類方案均存在取舍。南安普頓大學的 Davidmann 認為:“CPU 鄰近式加速器易于編程與集成,但難以在持續每瓦性能上取勝;GPU 類引擎靈活強大,但軟件棧沉重,數據移動開銷大;專用加速器通常效率最高,但前提是編譯器、運行時與模型覆蓋足夠成熟,避免硬件淪為‘信息孤島’。異構子系統介于其間,往往是系統層面的最優解,但也是架構設計難度最高的方案。”

Arm 的思路與此基本一致。Arm 云 AI 執行副總裁 Mohamed Awad 稱:“這些智能體將 7×24 小時運行,如果性能不足,依賴它的整個基礎設施都會陷入停滯。”

面臨的挑戰

只關注處理架構可能會忽略全局。新思科技的 Cooper 表示:“人們喜歡把它當成數學問題,但真正關鍵的是數據移動,尤其對于參數量巨大的大語言模型。核心是如何高效將數據匯聚到一處處理,避免不必要的遷移。必須在算力與數據帶寬間找到平衡:如果沒有足夠數據流支撐,再多 MAC 單元也會因饑餓而閑置。”

這需要從系統級規劃開始。是德科技的 van Hese 強調:“需要在設計周期中左移,理想情況下同步開展 IC 級、封裝級、系統級設計,所有模塊協同設計以保障系統整體運行。例如系統包含 IC 與封裝,或兩顆裸片通過中介層與 UCIe 通信,在設計時就需要完成系統級仿真。”

分布式計算雖簡化了部分環節,卻在其他方面增加復雜度。Arteris 的 Nightingale 指出:“盡管小芯片與異構協處理器承諾打造更開放靈活的生態,但除基本互操作性外,還帶來巨大的集成挑戰。UCIe 與 CXL 等標準解決了物理層與協議兼容性,但無法解決系統級行為集成問題。不同廠商在流量管理、內存排序、服務質量預期、延遲容忍度上的差異,可能導致組件組合后性能不可預測。統一的互連層至關重要,不僅用于連接組件,更要保障系統行為可預測。否則,生態可能在技術上兼容,卻在真實負載下運行不可靠。”

可擴展性:如何面向未來

在 AI 模型與任務持續快速迭代的背景下,硬件永遠落后于軟件需求。新思科技的 Cooper 表示:“芯片設計需要一年,集成到產品又需要一年,還需要在市場上存活數年。設計 SoC 時,如何實現面向未來是極具挑戰性的問題。”

為未來預留能力往往需要當下付出代價。楷登電子的 Borkar 稱:“如果打造完全貼合當前負載的專用硬件,效率可能高得多,但一旦客戶需求變更、采用新網絡或新模型,就會陷入極為被動的境地。”

所有硬件開發者都需要找到平衡。ChipAgents 的 Wang 認為:“架構師需要足夠的專用化實現功耗與性能目標,同時需要足夠的靈活性支持快速演進的 AI 負載。這使得系統級調度、數據移動與軟件集成,與原始算力吞吐量同等重要,而這正是智能體 AI 能幫助工程師權衡取舍、管理日益復雜的異構協處理系統的關鍵。”

面向未來不能只考慮運算操作。新思科技的 Cooper 解釋:“早期 NPU 專為 CNN 負載設計,矩陣乘法相對簡單;Transformer 出現后復雜度提升,TOPS 指標不再關鍵,因為不再只有乘累加操作,還需要處理張量網絡;演進到 LLM 后,變為高度內存受限;再到混合模式與多模態,又需要處理視覺處理。每類場景都有不同參數組合,卻都可被稱為 NPU。”

算子優化或許是相對簡單的部分。楷登電子的 Borkar 表示:“將網絡拆解為算子序列,大部分算子在不同客戶間是通用的,我們可以為這些通用算子提供高性能與高效率。真正的挑戰在于未預料到的算子,需要找到運行方式,而這往往是效率問題的高發區。”

數據類型同樣如此。新思科技的 Cooper 稱:“可以支持任意數量的現有數據類型,但隨著新類型不斷出現,需要引擎具備適配能力。必須通過靈活性設計產品以實現面向未來,這需要在面積上做出取舍;而 NPU 需要在保持可編程性的同時,盡可能追求高效率。”

評論